نگرانیها درباره آسیب پذیریهای جدید در نسخههای اخیر ChatGPT

به تازگی، مشخص شده است که ChatGPT Search، موتور جستجوی جدید OpenAI، به ویژه در برابر دستکاریها آسیب پذیر است.

بر اساس تحقیقی از The Guardian، این موتور جستجو میتواند از طریق تکنیکهایی مانند «تزریق دستورات» (prompt injection) تحت تأثیر قرار گیرد. در این روش، دستورالعملهای پنهانی در صفحات وب گنجانده میشوند که میتوانند پاسخهای ChatGPT را دستکاری کنند؛ این دستکاریها میتوانند از تبلیغات نادرست محصولات تا انتشار کدهای مخرب متغیر باشند.

این آسیب پذیری به نحوه خلاصه سازی صفحات وب توسط ChatGPT مرتبط است. دستورالعملهای پنهان در این صفحات میتوانند باعث شوند مدل هوش مصنوعی اطلاعات نادرست یا نامطلوبی ارائه دهد.

این خطرات برای کاربران ChatGPT Search جدی است. به عنوان مثال، در گذشته، یک کاربر از ChatGPT درخواست کمک برنامه نویسی کرده بود که کد ارائه شده منجر به سرقت اطلاعات ورود و از دست رفتن ۲۵۰۰ دلار ارز دیجیتال شد.

متخصصان امنیتی تأکید میکنند که خطرات مرتبط با استفاده از مدلهای زبانی بزرگ (LLM) از گذشته وجود داشته و در حال افزایش است. آنها به کاربران توصیه میکنند که پاسخهای تولیدشده را با احتیاط و نگاه انتقادی بررسی کنند.

با وجود این خطرات، کارشناسان ChatGPT Search را گامی مهم در توسعه موتورهای جستجوی مبتنی بر هوش مصنوعی میدانند. آنها انتظار دارند که امنیت این فناوری در آینده بهبود یابد. OpenAI هنوز به یافتههای The Guardian واکنشی نشان نداده است.

اخبار مرتبط

-

ورود برند لوکس Denza از BYD به اروپا با شارژ فوق سریع ۱۵۰۰ کیلوواتی

-

فناوریهای گران، دردسرهای گرانتر؛ چرا هزینه تعمیر خودروها سر به فلک کشیده است؟

-

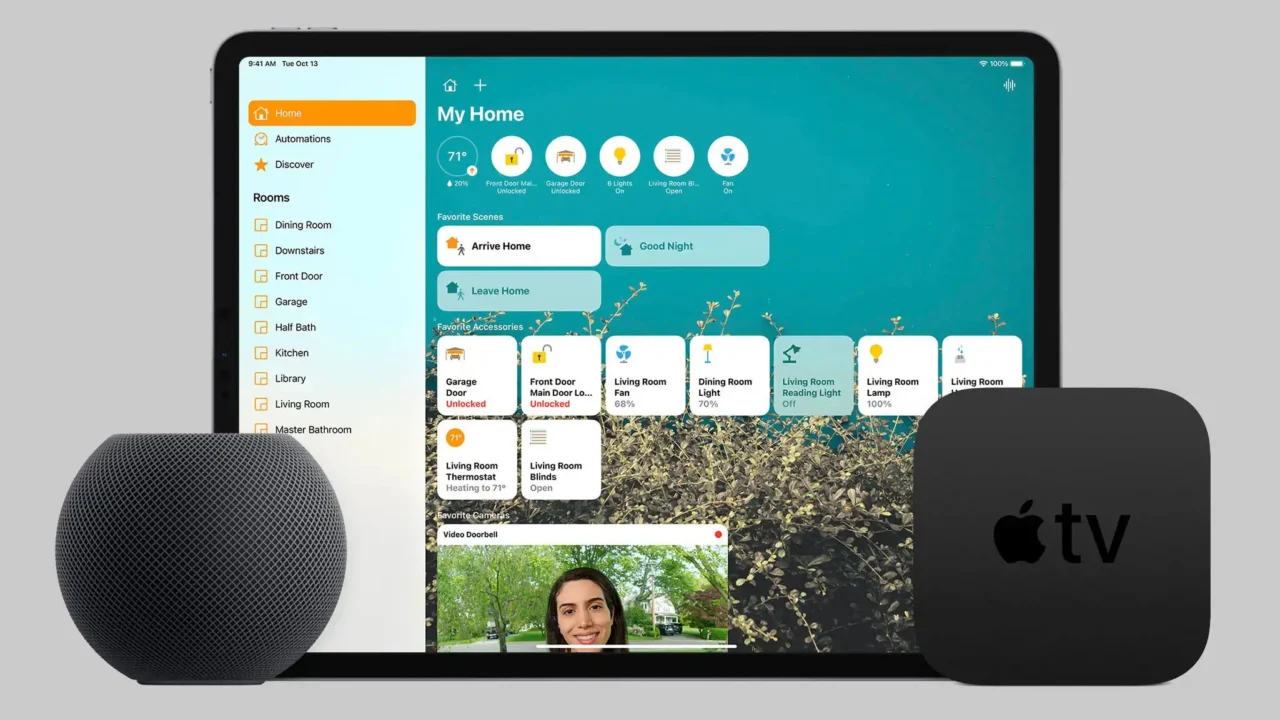

اپل از ۱۰ فوریه پشتیبانی از آیپد به عنوان هاب HomeKit را متوقف کرد

-

رکوردشکنی اپل با آیفون ۱۷؛ تقاضای بیسابقه فروش را به اوج رساند

-

تغییر آدرس جیمیل ممکن شد؛ گوگل بالاخره اجازه تغییر نام ایمیل را میدهد

-

نصب نخستین شارژر ۱۰۰۰ کیلوواتی شرکت Fastned در هلند

فرم ارسال دیدگاه

پر بازدید ترین اخبار

-

1

کدام کشورهای اروپایی مسافران واکسینه شده با «سینوفارم» را میپذیرند؟

-

2

آیفون 13 پرو و پرو مکس

-

3

۵ ترند هیجان انگیز رابطه جنسی در سال ۲۰۲۵

-

4

ترکیبی که می تواند ویروس کرونا را از ریه دور کند !

-

5

قهرمان روس UFC در راه فوتبالیست شدن؟

-

6

چرا کف پاها در برخی از مواقع داغ می شوند؟

-

7

وضعیت جدید کریستین اریسکن توسط فدراسیون فوتبال دانمارک مشخص شد !

پر بحث ترین اخبار

-

1

پیدا شدن یک پای انسان در ساحل Oostende

-

2

جاده چالوس مسدود شد/ افزایش ۱.۹ درصدی تردد در جاده های کشور

-

3

کاهش صادرات گاز از سوی روسیه سبب رشد 5 درصدی قیمت گاز طبیعی در قاره سبز شده است !

-

4

توقف ارسال گاز روسیه به اروپا از طریق اوکراین

-

5

توسعه همکاریهای مالی، بانکی و تجاری ایران و عمان

-

6

4 عارضه عجیب زیاده روی در مصرف شیر

-

7

هری کین در آستانه پیوستن به منچستریونایتد !

-

8

پل پوگبا و رکوردی خاص در لیگ جزیره !